近日,谷歌DeepMind团队发布了一项名为FACTS Grounding的全新基准测试,旨在提升大型语言模型(LLMs)的事实准确性,增强用户的信任感,并拓宽其应用边界。该测试的核心在于评估LLMs能否根据给定材料准确作答,同时避免产生“幻觉”,即不捏造信息。

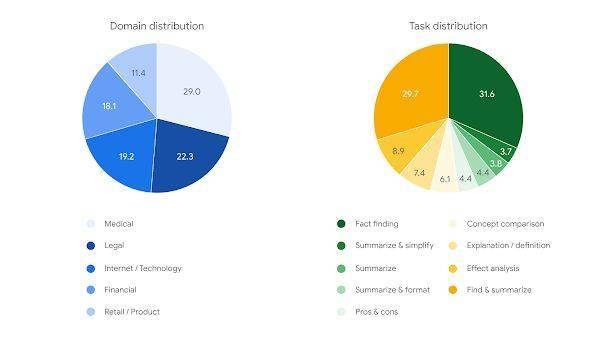

在数据集层面,FACTS Grounding数据集精心编制了1719个涵盖金融、科技、零售、医疗和法律等多个领域的示例。每个示例均包含一篇文档、一条要求LLM基于文档的系统指令以及相应的提示词。这些文档的长度各异,最长的文档包含约20000字的内容,确保了数据集的丰富性和多样性。用户请求的类型多样,包括摘要、问答生成和改写等,但不涉及需要创造力、数学或复杂推理的任务。

数据集被巧妙地分为860个“公共”示例和859个“私有”示例。目前,公共数据集已公开发布,供研究人员和开发者进行评估使用。而私有数据集则用于排行榜评分,这一设计旨在防止基准污染和排行榜作弊,确保评估的公正性和准确性。

在评估方案上,FACTS Grounding基准测试采用了Gemini 1.5 Pro、GPT-4o和Claude 3.5 Sonnet三款先进的模型作为评委,它们将共同评估答案的充分性、事实准确性和文档支持性。这一多模型评估体系能够更全面、客观地反映LLMs在事实准确性方面的表现。

评估过程分为两个阶段。首先,评委们会判断响应是否符合资格,即是否充分回答了用户请求。接着,他们会评估响应的事实准确性,即是否完全基于所提供的文档,没有产生“幻觉”。最终,基于模型在所有示例上的平均得分,计算出每个LLM在FACTS Grounding基准测试中的表现。

值得注意的是,在FACTS Grounding基准测试中,谷歌自家的Gemini模型在事实准确的文本生成方面脱颖而出,取得了最高分。这一成绩不仅展示了Gemini模型在事实准确性方面的卓越表现,也验证了FACTS Grounding基准测试的有效性和可靠性。