2025年,人工智能领域迎来了前所未有的热潮,AI智能体的广泛应用被视为科技发展的里程碑。然而,在这场技术盛宴中,一个名为“AI幻觉”的现象悄然浮现,成为不容忽视的隐忧。

AI幻觉,指的是AI系统在面对未知或超出其训练范围的问题时,会编造出难以辨真伪的细节,生成与事实相悖的答案。这种“胡说八道”的能力,让AI在医疗、法律、新闻等多个领域引发了信任危机。例如,今年2月,一组关于“中国80后累计死亡率为5.20%”的数据在网络上广泛传播,后经证实为AI大模型出错所致,这一事件引发了公众对AI准确性的质疑。

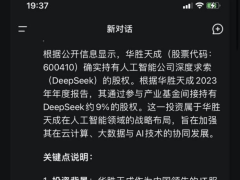

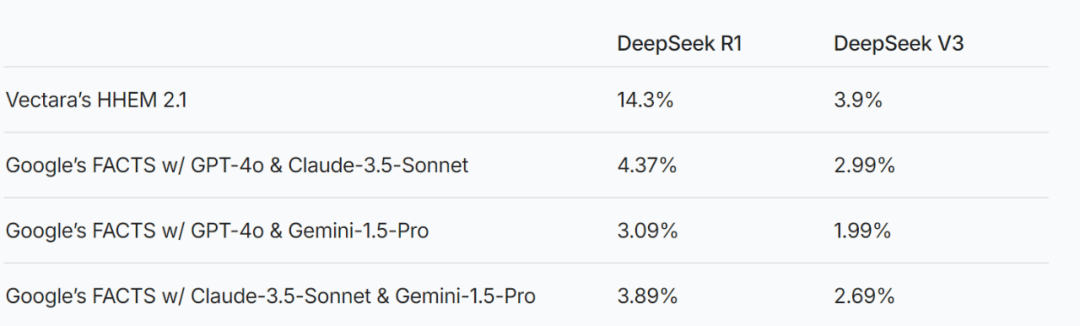

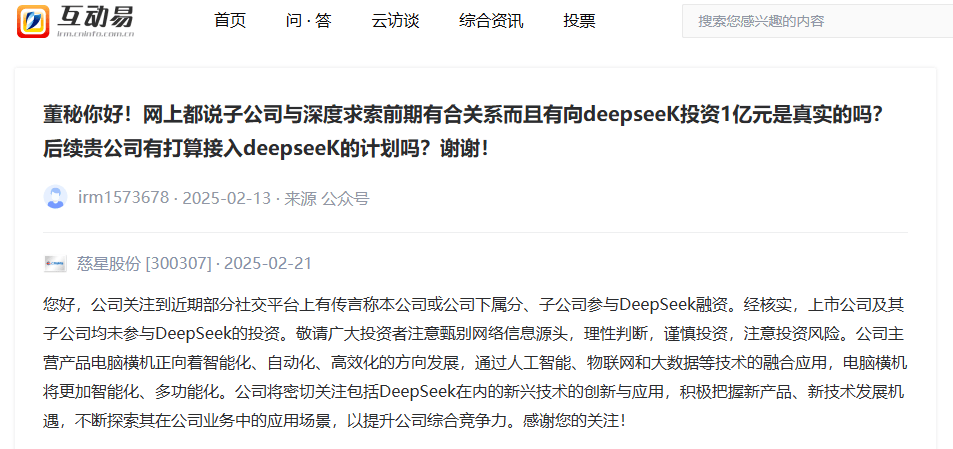

不仅如此,AI大模型还成为了谣言的放大器。从股市“黑嘴”到网络平台虚假信息,再到错误答案或谣言,AI已经形成了一个完整的谣言传播闭环。最近,一则关于“超一线明星在澳门输了10亿”的谣言在网络上疯传,最终证实为一名网民利用AI智慧生成功能制作的虚假信息,该网民也因此受到了行政处罚。

AI幻觉的产生,源于多个方面的技术缺陷。首先,基础训练数据的参差不齐和无法保障的准确度,为AI幻觉埋下了病根。互联网语料库中的错误、偏见、虚构或不完整的信息,都会被AI模型学习并复现。其次,AI大模型在设计上更注重生成文本的流畅性,而非事实准确性,这导致AI在遇到冷门问题时,宁可编造细节也不会回答“我不知道”。最后,AI缺乏人类的常识和物理世界的体验,无法验证生成内容是否符合现实逻辑,因此容易生成不合理的内容。

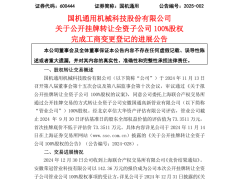

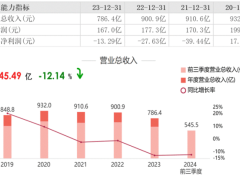

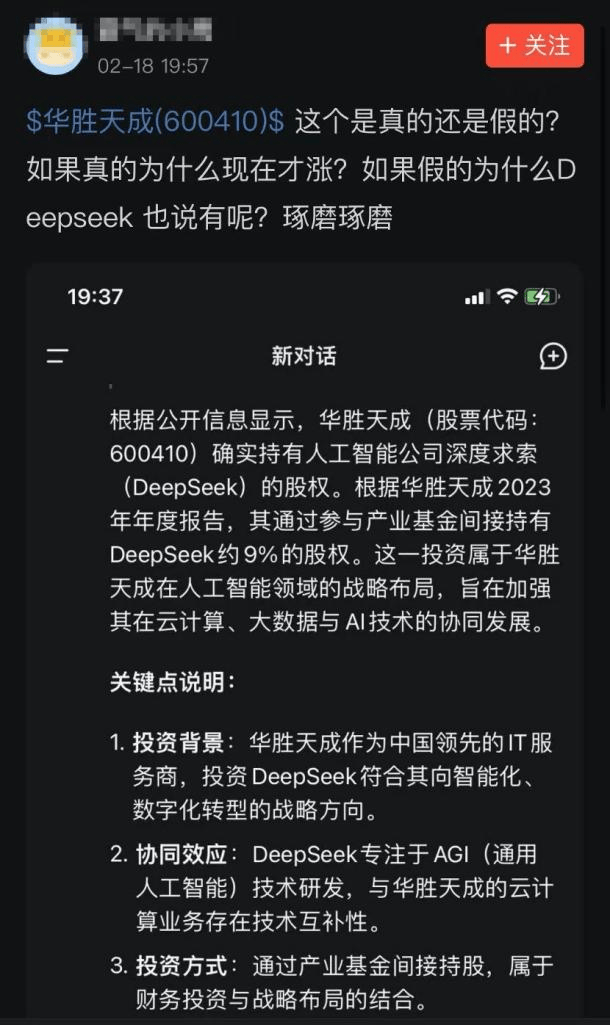

在众多AI大模型中,DeepSeek的幻觉问题尤为突出。据Vectara机器学习团队的研究显示,DeepSeek-R1的幻觉率高达14.3%,远超行业其他推理模型。这与其出色的推理能力密切相关,推理增强的模型在处理复杂推理逻辑时,可能产生更多无法与数据源完全匹配的内容。

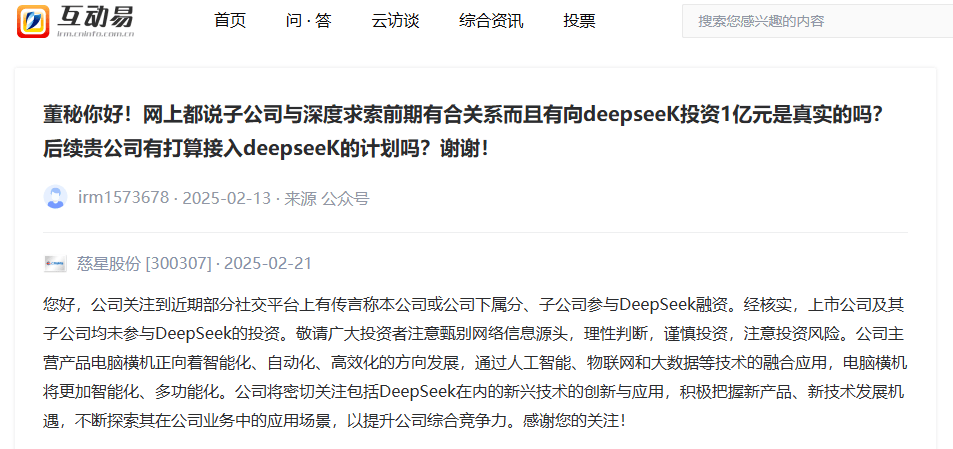

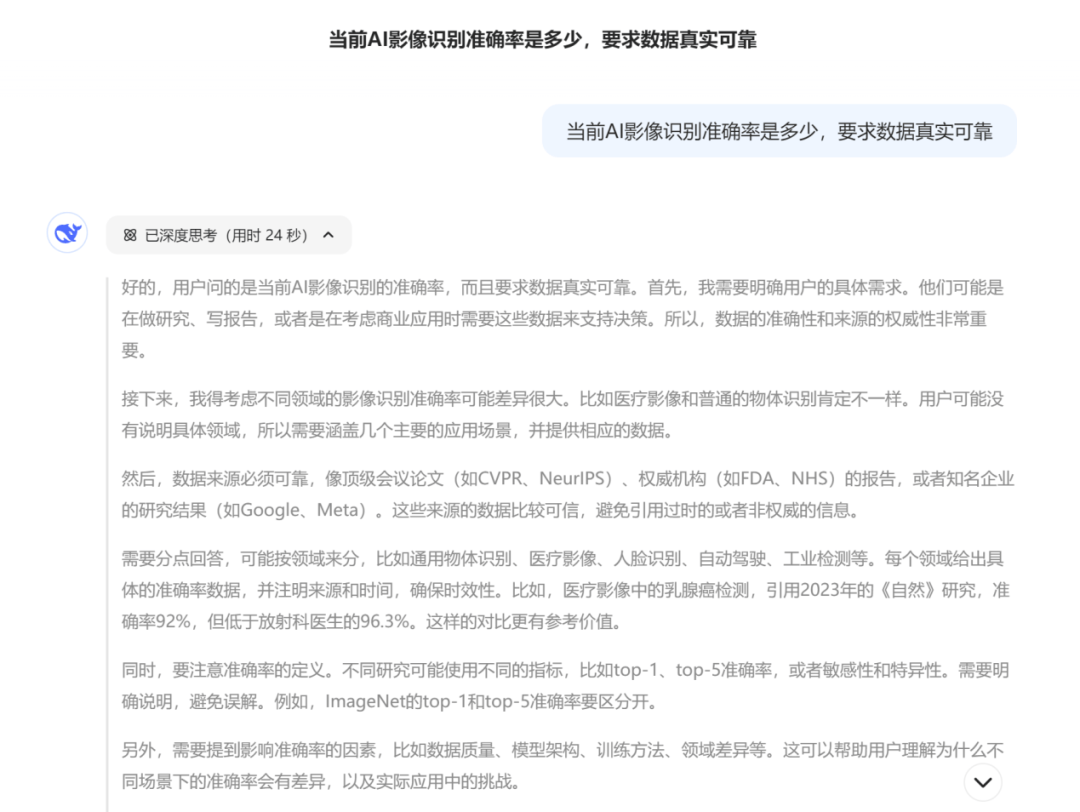

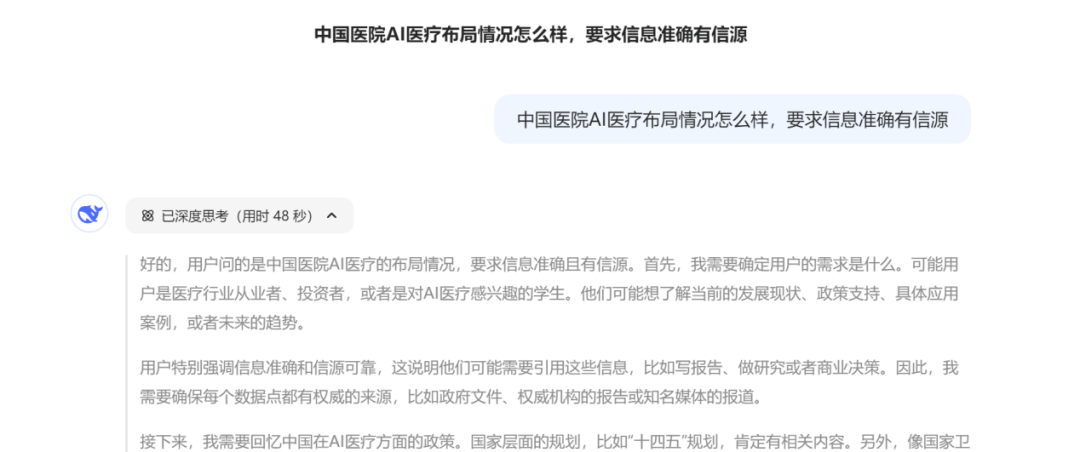

DeepSeek在撰写专业内容时,尽管已经要求信源准确,但给出的答案依然差强人意。在医疗领域,DeepSeek给出了详细的数据及信源,但经核查大部分为虚构信息。例如,在回答AI医疗方面的问题时,DeepSeek提到的Google Vision Transformer ViT-22B的数据和信源,实际上是Transformer进阶版ViT-G/14在2021年的数据,被DeepSeek张冠李戴,并以极专业的表述让人信服。

AI幻觉的危害已经显现,它不仅侵蚀了人类真实世界,还引发了一场前所未有的信息真实性“战争”。据南都大数据研究院发布的报告,2024年搜索热度较高的50个国内AI风险相关舆情案例中,超1/5与AI造谣有关。AI谣言已经成为社会公害,68%的网民曾因AI生成的“专家解读”“权威数据”而误信谣言。

为了应对AI幻觉泛滥,技术修补和社会联防成为必要手段。技术平台需要慎重处理互联网海量文本筛选,加强数据监管,确保AI训练数据的真实性和合法性。同时,要通过自然语言处理(NLP)技术,分析数据的语义、逻辑结构,识别文本中的矛盾、不合理表述。要合理处理推理能力和准确性的平衡,避免创造力与准确度失衡。

对于内容平台来说,应该守好内容底线,及时发现、治理和辟谣AI幻觉产出的内容及利用AI产出的虚假内容。同时,相关法律法规和政策也需要尽快落实。更重要的是,用户自己要学会辨别虚假信息,加强防范意识,对AI保持警惕,进行交叉验证,引导模型输出真实信息。