在刚刚过去的春节假期,一款名为DeepSeek的中国国产大模型意外走红,成为了科技领域的话题焦点。这款大模型不仅引起了业界的广泛关注,还深入到了普通人的生活与工作中。

DeepSeek的发布可以追溯到1月20日,由中国大模型公司深度求索推出其推理大模型DeepSeek-R1。该模型的发布迅速在业界引起了轰动,仅仅一周后的1月27日,DeepSeek应用便成功登顶苹果中国区和美国区应用商店的免费App下载排行榜。紧接着,在1月31日,美国科技巨头英伟达、亚马逊和微软在同一天宣布接入DeepSeek-R1,进一步彰显了其影响力。

DeepSeek的成功不仅仅是AI领域的一次突破,更是一次破圈现象。它不仅在技术上达到了国际先进水平,更重要的是,其可用程度和完成度极高,引发了广泛的讨论,从而吸引了众多普通人的关注。这款大模型的出现,让AI技术更加贴近人们的生活,成为了他们日常工作和生活的一部分。

DeepSeek的成功也体现了国产大模型的能力。它不仅展示了中国AI技术的实力,还有望追赶甚至反超世界先进水平。DeepSeek还大幅降低了AI模型的训练成本。据悉,其R1模型的训练成本仅为557.6万美元,相比之下,OpenAI的GPT模型训练成本则高达1亿美元。

面对DeepSeek所取得的成就和业界的广泛赞誉,深度求索(DeepSeek)的创始人梁文锋却表现得十分谦逊。他表示:“我们不过是站在开源社区巨人们的肩膀上,给国产大模型这栋大厦多拧了几颗螺丝。”梁文锋所提到的“巨人”——开源社区,即开放源代码,它允许用户利用源代码进行修改和学习,为技术的发展提供了巨大的推动力。

开源策略不仅具有世界大同的美好愿景,同时也承载着利益动机。通过开源,可以吸引全球开发者和研究者的关注,形成一个强大的技术社区。这个社区具备敏捷性和协作优势,能够形成“技术共享-生态繁荣-反哺创新”的正向循环。因此,在竞争中处于弱势的一方往往会选择开源策略来扭转局势。在计算机行业中,一个封闭的生态往往对应着一个开放的、开源的生态。

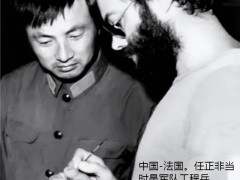

如今,开源已经成为AI迅猛发展的助推剂。meta首席人工智能科学家、2018年图灵奖得主杨立昆在评价DeepSeek时指出:“与其说是中国在人工智能上超越美国,不如说是开源代码正在超越私有模式。DeepSeek从开放研究和开放源码中受益良多,例如meta的PyTorch和LLaMA等项目。”

实际上,meta在推动AI大模型开源方面发挥了重要作用。从LLaMA大模型到图像分割模型Segment-Anything,meta开源的项目覆盖了各种模态和场景。其中,LLaMA是最强大的开源大模型之一。2023年7月,meta发布的LLaMA2更是将开源协议从“仅研究可用”转向“免费可商用”,虽然催生了一大批“套壳大模型”,但也改变了大模型竞争中OpenAI独占鳌头的格局。在这些开源大模型中,DeepSeek无疑是最强大的之一。

DeepSeek的成功验证了开源模型可以接近甚至达到闭源性能的水平,这反过来将促使meta等巨头加大对开源AI的投入。最近,meta又开源了多个AI项目,包括图像分割模型SAM 2.1、多模态语言模型Spirit LM等,进一步提升了AI在图像处理和语音识别领域的能力。

然而,尽管开源促进了AI的迅猛发展,但我们也应该看到其中的隐忧。开源的本质是用开放促效率,但在当今世界,效率在很多时候已经不再是第一位的考虑。AI技术是由软硬件两方面构成的,在硬件逐渐走向封闭的同时,软件的开源是否也会走向封闭?这是一个值得中国AI界深思的问题。因此,我们需要提前做好应对之策,用创新和开放来回应封闭的挑战,正如DeepSeek所做的那样。