meta近期推出了其最新的Llama 4系列AI模型,这一系列包括了Llama 4 Scout、Llama 4 Maverick和Llama 4 Behemoth三款模型。据meta透露,这些模型均经过了庞大的未标注文本、图像和视频数据的训练,旨在赋予它们广泛的视觉理解能力。

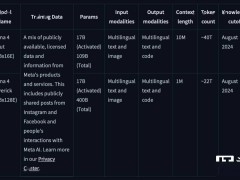

目前,meta已将Scout和Maverick两款模型上架至Hugging Face平台。而Behemoth模型仍在紧锣密鼓的训练中。Scout模型能够在单个英伟达H100 GPU上运行,而Maverick则需要更高配置的英伟达H100 DGX AI平台或性能相当的设备。

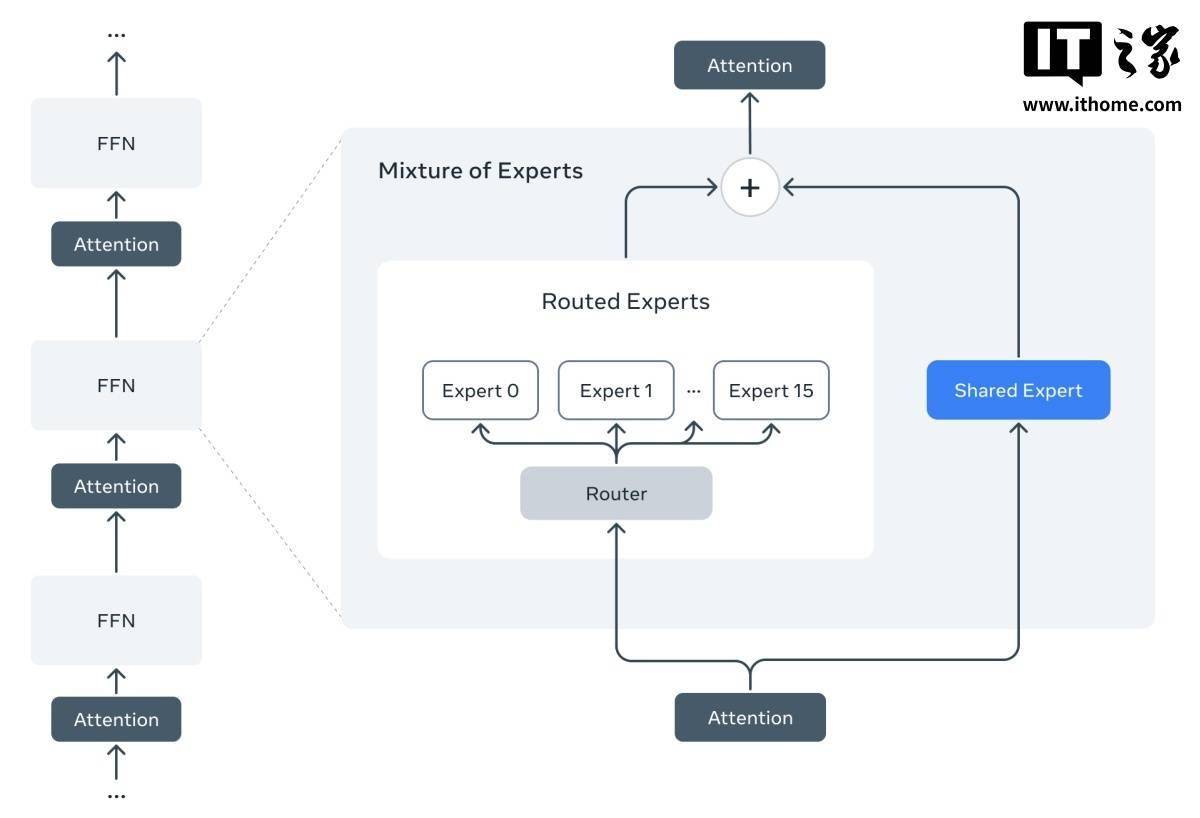

值得注意的是,Llama 4系列是meta首次采用混合专家(MoE)架构的模型。这种架构通过将数据处理任务分解为多个子任务,再将这些子任务分配给更小的、专门化的“专家”模型,从而在训练和回答用户查询时展现出更高的效率。例如,Maverick模型拥有4000亿个参数,但在128个“专家”模型中,只有170亿个参数处于活跃状态。

相比之下,Scout模型拥有170亿个活跃参数,分布在16个“专家”模型中,总参数数为1090亿个。尽管Llama 4系列模型在性能上有所提升,但它们并非像OpenAI的o1和o3-mini那样的“推理模型”。推理模型会对答案进行事实核查,通常能更可靠地回答问题,但响应时间相对较长。

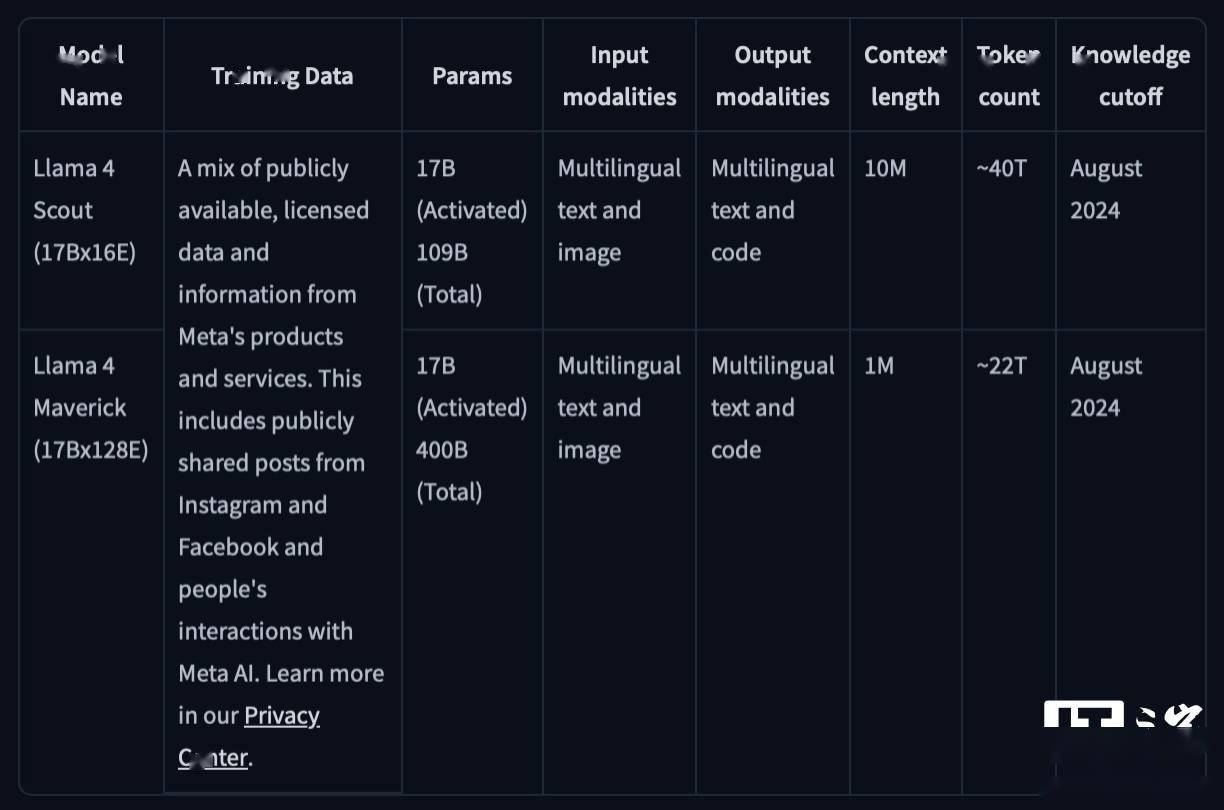

meta内部测试显示,Maverick模型在通用AI助手和聊天等应用场景中表现出色,尤其在创意写作、代码生成、翻译、推理、长文本上下文总结和图像基准测试等方面,其性能超过了OpenAI的GPT-4和谷歌的Gemini 2.0等模型。然而,与谷歌的Gemini 2.5 Pro、Anthropic的Claude 3.7 Sonnet和OpenAI的GPT-4.5等更强大的最新模型相比,Maverick仍有一定的提升空间。

Scout模型则擅长总结文档和基于大型代码库进行推理。该模型支持处理1000万个词元,这意味着它一次能够处理数百万字的文本。meta还预告了其Behemoth模型。据透露,Behemoth拥有2880亿个活跃参数,分布在16个“专家”模型中,总参数数接近2万亿个。meta内部基准测试显示,在一些衡量解决数学问题等科学、技术、工程和数学(STEM)技能的评估中,Behemoth的表现优于GPT-4.5、Claude 3.7 Sonnet和Gemini 2.0 Pro,但略逊于Gemini 2.5 Pro。